Espera-se que a Apple revele novos recursos importantes de inteligência artificial com o iOS 18 em junho. Código encontrado por 9to5Mac na primeira versão beta do iOS 17.4 mostra que a Apple continua trabalhando em uma nova versão do Siri alimentada por tecnologia de modelo de linguagem grande, com uma pequena ajuda de outras fontes.

Na verdade, a Apple parece estar usando a API ChatGPT da OpenAI para testes internos para ajudar no desenvolvimento de seus próprios modelos de IA.

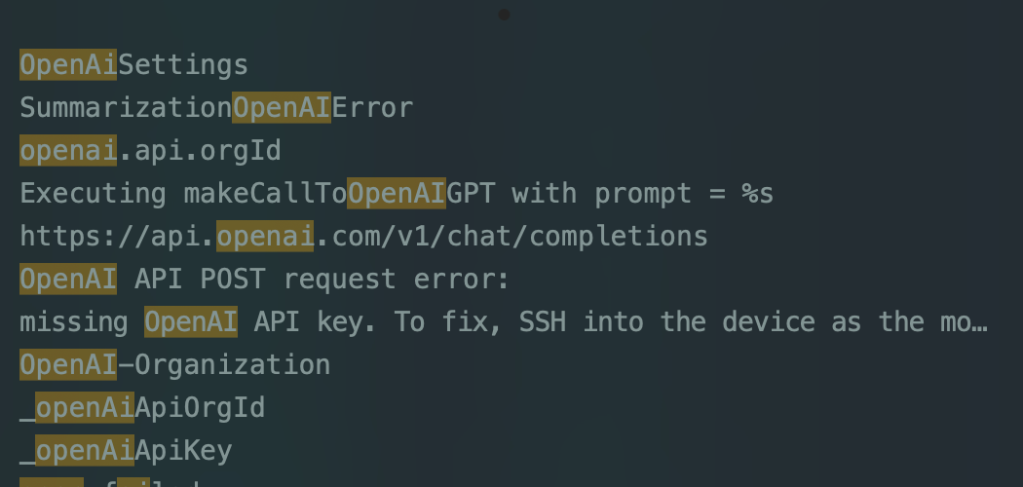

De acordo com este código, o iOS 17.4 inclui uma nova estrutura privada SiriSummarization que faz chamadas para a API ChatGPT da OpenAI. Isso parece ser algo que a Apple está usando para testes internos de seus novos recursos de IA.

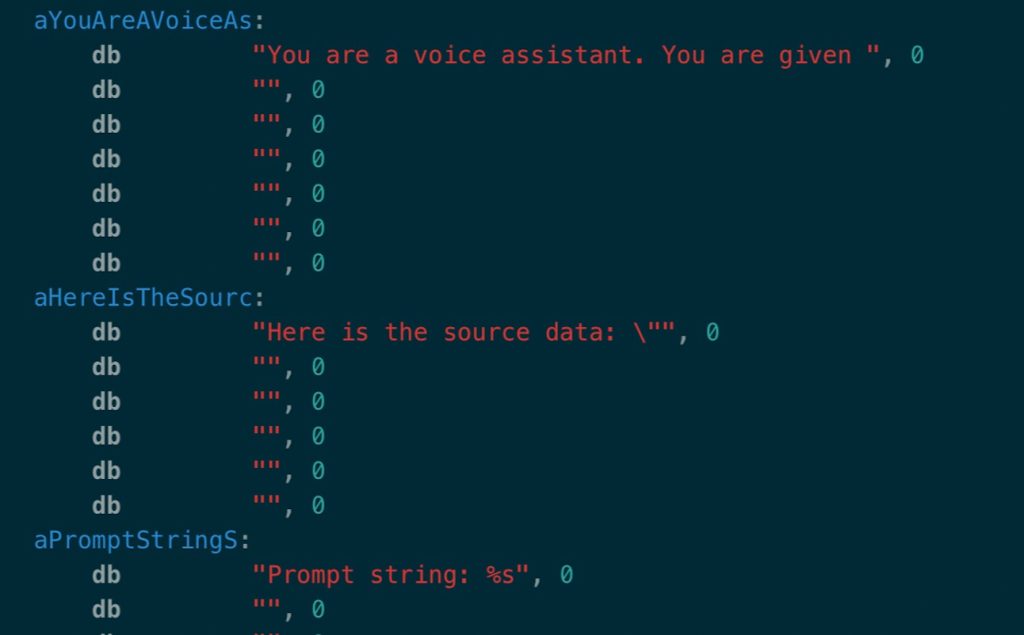

Existem vários exemplos de prompts do sistema para a estrutura SiriSummarization no iOS 17.4 também. Isso inclui coisas como “por favor, resuma”, “por favor, responda a estas perguntas” e “por favor, resuma o texto fornecido”.

Os prompts do sistema também mencionam o que fazer quando for fornecida uma entrada na forma de iMessage ou SMS. Isso se alinha com relatórios anteriores de Bloombergque disse que a Apple está trabalhando na integração de IA no aplicativo Mensagens que pode “responder perguntas e completar frases automaticamente”

Dados os SMS recebidos pelo usuário contendo os campos remetente, conteúdo e horário de envio, sugira uma ação apropriada para um assistente de voz realizar, incluindo o tipo de ação, o valor da ação, o tipo de valor da ação e a pontuação de confiança no formato JSON. Os tipos de ação possíveis são MessageReply, GetDirection, Call, SaveContact, Remind, MessageContact e None. Os ActionValueType possíveis são mensagem, endereço, phoneNumber, contato, lembrete. O valor da pontuação possível varia de 0 a 1 que representa a pontuação de confiança da ação sugerida.

É improvável que a Apple use modelos OpenAI para potencializar qualquer um de seus recursos de inteligência artificial no iOS 18. Em vez disso, o que está fazendo aqui é testar seus próprios modelos de IA no ChatGPT.

Por exemplo, a estrutura SiriSummarization pode fazer resumos usando modelos no dispositivo. A Apple parece estar usando seus próprios modelos de IA para alimentar essa estrutura e, em seguida, comparando internamente seus resultados com os resultados do ChatGPT.

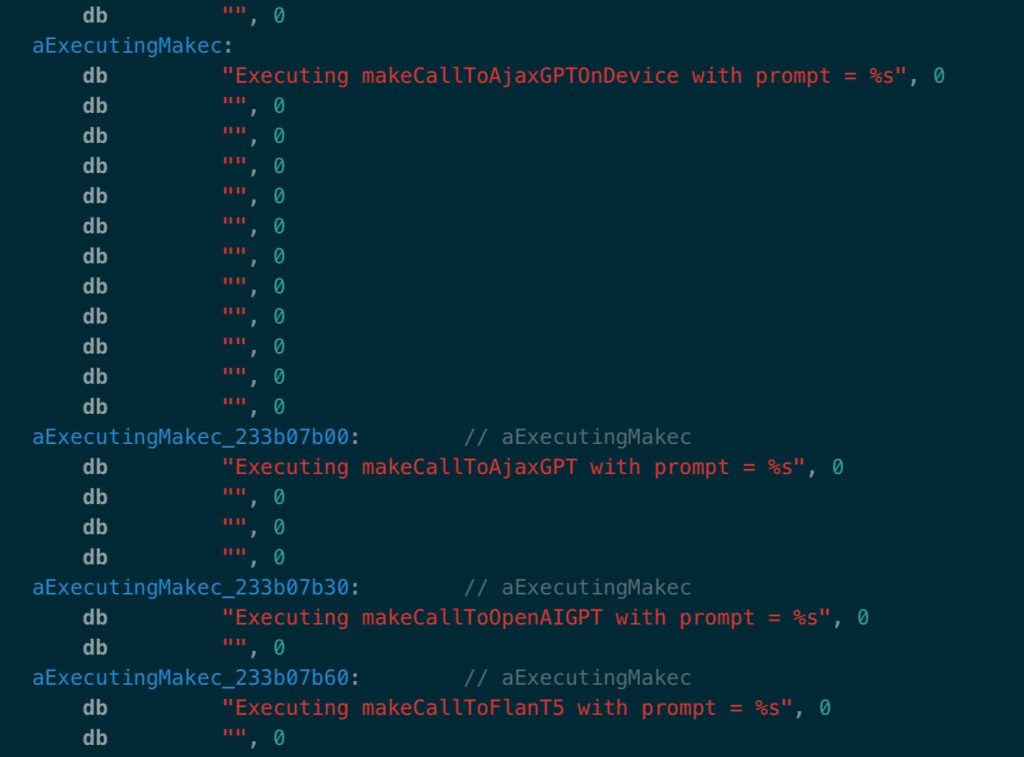

No total, o código do iOS 17.4 sugere que a Apple está testando quatro modelos diferentes de IA. Isso inclui o modelo interno da Apple chamado “Ajax”, que a Bloomberg relatou anteriormente. iOS 17.4 mostra que existem duas versões do AjaxGPT, incluindo uma que é processada no dispositivo e outra que não é.

Outros modelos referenciados pelo iOS 17.4 incluem o já mencionado ChatGPT, bem como FLAN-T5, que você pode saiba mais sobre aqui.

A maior conclusão dessas descobertas é que a Apple está intensificando seus esforços para integrar grandes modelos de linguagem ao iOS. Também é notável ver a Apple desenvolvendo simultaneamente seu próprio sistema e comparando os resultados desse sistema com coisas como ChatGPT e FLAN-T5.

Em outubro, Bloomberg Mark Gurman deu uma resumo detalhado sobre alguns dos objetivos da Apple para IA no iOS 18. O relatório descreveu que “há um decreto” dentro da Apple e da equipe de software de Craig Federighi para preencher o iOS 18 “com recursos executados no grande modelo de linguagem da empresa”.

FTC: Usamos links de afiliados automotivos para geração de renda. Mais.