O primeiro beta de desenvolvedor dos primeiros recursos do Apple Intelligence foi lançado esta semana, o que inclui algumas melhorias iniciais da Siri – junto com uma interface nova extremamente bonita. Embora eu esteja no Reino Unido, consegui usar essa abordagem para obter acesso.

Como a Apple chamará todos os novos recursos de beta quando forem lançados, o que podemos testar atualmente é efetivamente o primeiro beta de um produto beta – então as expectativas devem ser definidas de acordo…

O que teremos em algum momento – talvez até o fim do ano – é uma Siri totalmente nova, com capacidades dramaticamente melhoradas. Mas isso ainda está muito longe.

O que o primeiro beta do desenvolvedor fornece é apenas o primeiro passo para tornar a Siri mais inteligente. Aqui está o que está oficialmente incluído:

- Uma nova (e extremamente bonita!) interface de usuário

- A liberdade de alternar entre voz e texto

- A capacidade de lidar com perguntas de suporte da Apple

- Lidando com tropeços verbais

- Manter a compreensão contextual para consultas de acompanhamento

Tomando cada um por sua vez…

A nova IU – bonita, mas confusa

Primeiro, eu absolutamente amor a nova UI. É honestamente uma das peças de design de software mais bonitas que já vi em muito tempo.

Se você acessar e segurar o botão lateral, a animação começa até mesmo da posição do botão e se espalha a partir daí. É lindo.

No entanto… Também é confuso. Estamos vendo uma animação totalmente nova para o que é, atualmente, principalmente a antiga Siri. Efetivamente, a mudança na IU parece sinalizar uma grande mudança, mas só entrega uma pequena. Seria muito melhor, na minha opinião, para a nova IU esperar pelos recursos completos da nova Siri.

Alternando entre voz e texto

Eu trabalho em casa e moro em Londres, onde ninguém vai dar a mínima para o que você diz ao seu telefone em público, então, para mim, pessoalmente, quase sempre fico feliz em dar voz aos pedidos da Siri.

De qualquer forma, acho fantástico dar às pessoas a escolha, e o gesto de toque duplo na parte inferior da tela é uma maneira muito fácil de acessá-lo. Esta é uma ótima peça de design de UI.

Lidando com perguntas de suporte da Apple

No momento, esse é o recurso mais impressionante. Eu o testei em um monte de consultas e ele deu ótimas respostas para todas elas.

Por exemplo:

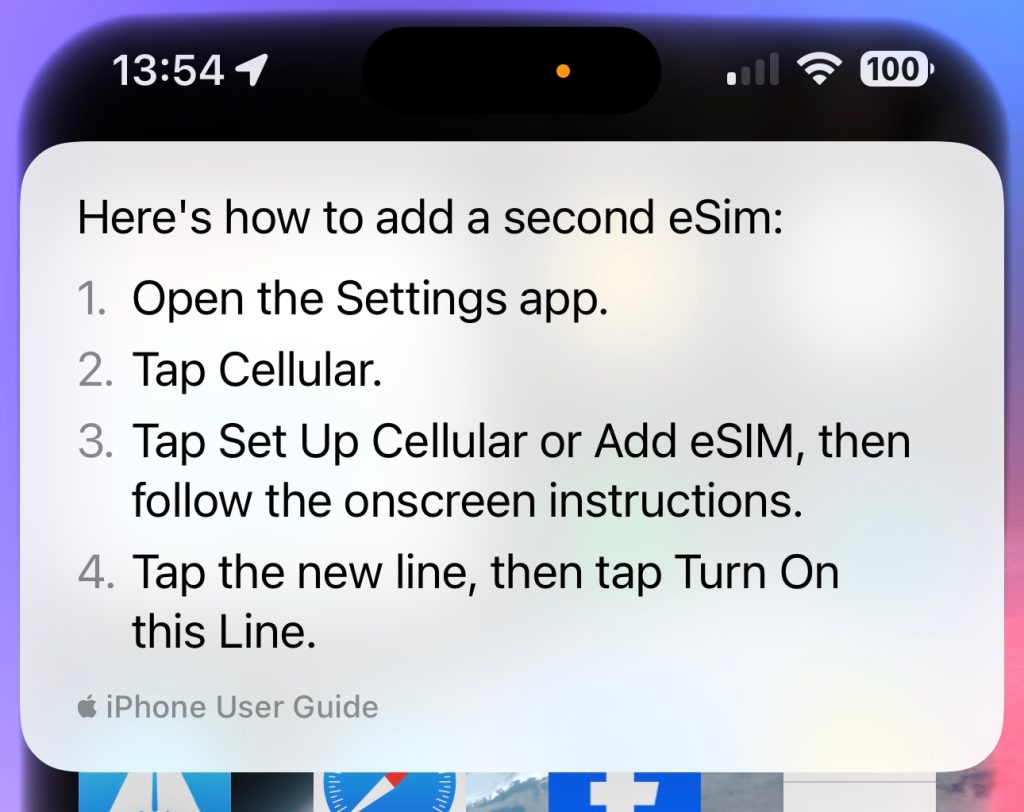

Siri, como adiciono um e-SIM ao meu iPhone?

Siri respondeu com um ótimo resumo, que seria perfeitamente adequado para qualquer um acompanhar:

Mas se precisar de mais informações, basta tocar em qualquer lugar da resposta e o documento de suporte apropriado será aberto.

Aliás, essa é outra razão para a Apple manter o inglês dos EUA por enquanto. Como tive que mudar a região do meu iPhone para os EUA e o idioma para inglês dos EUA, então a configuração está de fato em Celular – mas para um iPhone do Reino Unido normalmente seria Dados Móveis. Então, há muitas partes móveis para fazer o Apple Intelligence funcionar em todo o mundo.

Lidando com tropeços verbais

Isso também é realmente impressionante. Tentei mudar de ideia sobre o que estou perguntando no meio de uma consulta, e a Siri lida com isso sem pestanejar. Por exemplo:

Que horas são em Nova York? Não, Chicago. Não, quero dizer, São Francisco?

Siri apenas revirou os olhos metaforicamente e me disse que horas eram em São Francisco.

Manter a compreensão contextual

É aqui, infelizmente, que as coisas fracassam – e isso ocorre principalmente porque a Siri não é fundamentalmente mais inteligente, então todas as respostas “Aqui está o que encontrei na web” ainda acontecem. Por exemplo:

Eu: O que é Apple Intelligence?

Siri: Você pode encontrar detalhes sobre todos os produtos Apple em apple.com

Às vezes, funciona bem. Por exemplo, esta interação:

Eu: Que horas são em Mumbai?

Siri: São 18:37 em Mumbai, Índia

Eu: E como está o clima aí?

Siri: Está chovendo e a temperatura está em 28°C em Mumbai, Índia

(Devo observar que, depois de definir os EUA como minha região, alterei manualmente o horário de volta para 24 horas e a temperatura de volta para Celsius.)

No entanto, o contexto só se aplica à sessão atual do Siri – isto é, enquanto a animação estiver na tela. Uma vez que o tempo limite se esgota, o que acontece depois de cerca de seis segundos, ele esquece o contexto. Então, esperar 10 segundos e então perguntar “E Como está o tempo lá?” voltei para o meu clima local, apesar das dicas verbais destacadas de que ainda estou me referindo a Mumbai.

Para a maioria das consultas, no entanto, Siri não é mais inteligente. Por exemplo, esta interação:

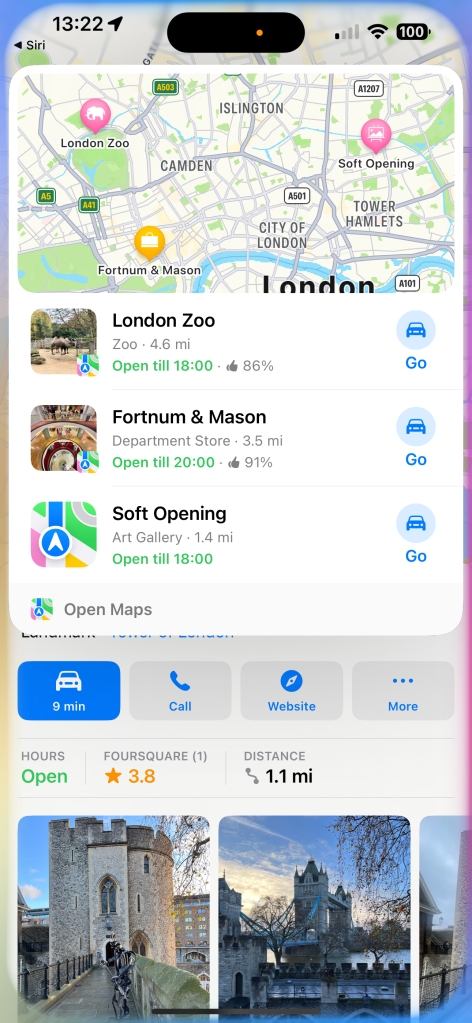

Eu: Quanto tempo levarei para chegar à Torre de Londres?

Siri: Qual deles?

Meu:

Siri:

Eu: E qual é o horário de funcionamento?

Siri:

Então, sim, não espere muito!

Mas, como eu disse, esta é a primeira versão beta de um produto beta, então tudo isso é esperado. O que será interessante ver é o ritmo das melhorias e exatamente quanto tempo teremos que esperar todos os novos recursos da Siri.

Imagem: colagem 9to5Mac usando fundo de Alexandre Cinza sobre Desaparecer